“养龙虾”与“建虾塘”:医疗AI智能体底座选型思考

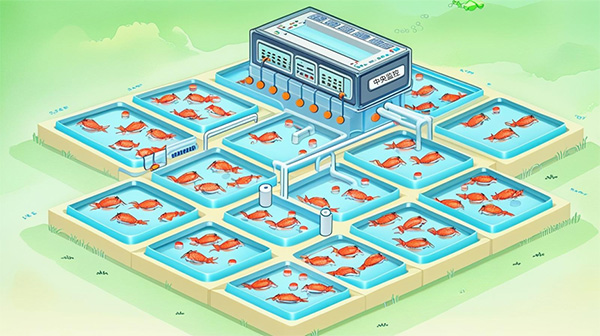

2026年被广泛视为“企业级AI Agent商业化元年”。从代码生成到自动化流程,再到年初的“龙虾 (OpenClaw)” 热潮,AI正在快速从“演示”走向“实际生产环境”。而想让医疗智能体的商业化、规模化落地,医疗机构需选好合适的技术底座。正如想养好“龙虾”,一定要先建好”虾塘”。

医疗智能体落地,绕不开的三个现实问题

1.领域专业性 - “虾塘”里的智能体能“真正理解”医疗么?

医疗指标背后是复杂的业务逻辑。同一个临床数据,在不同科室、不同患者背景下,实际含义和处理方式截然不同。智能体可以识别指标异常,却不一定能准确判断该异常在具体临床情境中的真实意义。

即便在同一个“虾塘”中,影响智能体行为的,不只是个体能力,更取决于环境条件。通用大模型能“读懂”文字,但难以理解医院内部的业务口径和统计规则。智能体的输出如果不贴合实际业务逻辑,就无法被临床和管理人员信任。

2.安全合规 - 如何约束“龙虾”的运行边界,确保医疗数据可控、可信、可被审计

医疗数据的敏感性决定了任何AI应用都必须满足严格的合规要求。《网络数据安全管理条例》(国务院令第790号,2024年9月公布)第十九条针对生成式人工智能服务,要求加强对训练数据和训练数据处理活动的安全管理;国家卫生健康委等五部门联合发布的《关于促进和规范“人工智能+医疗卫生”应用发展的实施意见》(2025年10月印发)也明确提出要“强化数据安全和个人隐私保护”并“建立健全智能应用数据安全防护体系,促进数据规范流通共享”。

在“虾塘”中,这意味着每一只“龙虾”都只能在既定水域内活动,而不是任意越界或相互穿行。智能体的应用不能以牺牲数据安全和控制力为代价,而是需要通过私有化部署、细粒度权限、操作审计等安全合规能力,确保AI调用记录可追溯、可审计。

3.规模化应用 - “龙虾”多了,“虾塘”能撑得住吗?

很多AI项目在试点阶段表现良好,但向全院级扩展时,常因数据基建缺乏企业级稳定性而陷入困境。在“虾塘”中,当“龙虾”密度不断上升,如果缺乏有效的分区与调度机制,它们就会相互影响,甚至挤占彼此的生存空间。

核心挑战在于:单点环境往往掩盖了资源调度的深层缺陷。一旦进入全院级应用,多智能体并行引发的算力和存储争抢,可能使底层基建难以保障核心业务的响应优先级。同时,缺乏适配智能体的全局监控与自动化治理能力,模型幻觉和响应时延在复杂业务流中被不断放大,系统难以满足全院级医疗场景对高可用、高可靠的严苛要求。企业级稳定性、资源调度与运维能力,正是智能体从演示走向生产力的关键跨越。

如何建好智能体“虾塘”,让智能体真正落地

如果说智能体是“龙虾”,那么企业级AI的竞争,本质上是“虾塘”的竞争。一个真正可用于医疗生产环境的智能体底座,需要同时具备三类能力:业务理解能力、安全合规能力、大规模业务支撑能力。

1.懂养虾:智能体“虾塘”需具备领域知识,语义理解和专家意图都要会

智能体要进入真实业务,光有“通用正确”远远不够。它必须具备领域语义能力,将临床路径、数据口径与业务规则转化为可执行的语义模型。这就像在一个复杂的“虾塘”中,不同水域的水温、密度与状态各不相同。看似相似的信号,如果脱离具体环境,很容易被误判;只有结合上下文,才能做出真正有意义的判断。

只有当医学知识、院内规范与数据定义被真正内化,智能体的输出才能从“听起来对”,走向“用起来对”,在复杂多变的业务环境中持续给出稳定、可信的判断。

2.管好虾:“虾塘”要能具备控制每只龙虾的行为能力,访问控制和数据安全很重要

养虾最怕虾“越狱”。每一次智能体调用都涉及核心系统与敏感数据。“虾塘”必须具备细粒度权限控制、数据访问约束与全流程审计能力,确保所有行为可控、可追溯、可合规运行。

3.护好塘: 虾再多塘也不能塌,隔离、负载和容灾一个都不能少

新手养虾常常容易投太多虾苗,密度上来了才发现虾塘撑不住。医疗智能体也一样,试点时一个科室用着挺好,等到全院铺开,几十个智能体同时跑,有的调病历、有的跑质控,都在抢算力、抢存储。因此底座需要具备资源隔离、弹性扩展与高可用等能力,支撑多智能体并行运行而不影响核心业务系统稳定性。虾多了,塘更要稳得住。

当前智能体落地的三种主流路径

在实践中,医疗机构通常会基于已有技术栈去承载AI智能体,大致可以归为三类路径。但这些路径在面对“真实生产环境的医疗智能体”时,往往都会暴露出各自的结构性问题。

1.通用AI技术栈(LLM+RAG)

这是当前最常见的起步方式,通过接入大模型、构建知识库(RAG)来实现初步的智能能力。问题在于,这类架构本质上是“文本理解系统”,而非“医疗业务系统”。它可以回答医学知识问题,但难以处理医院内部复杂的业务语义,例如诊疗路径、统计口径、流程约束等。

更关键的是,这类架构通常游离于医院核心系统之外,无法直接参与真实业务流程,最终只能停留在“辅助问答”或“信息检索”的层面。

2.数据平台路径(数据湖 / 数据仓库 / CDP)

部分医院会尝试在现有数据平台上叠加AI能力,希望通过整合全院数据来支撑智能体。这类路径的问题在于:数据平台的设计目标是“分析”,而不是“执行”。

● 数据通常以离线或准实时方式更新

● 缺乏对业务流程的实时响应能力

● 难以直接驱动临床或运营动作

这意味着,虽然数据“被汇聚了”,但智能体依然无法真正嵌入业务流程,形成闭环。

3.传统集成平台路径

集成平台长期作为医院信息系统的“数据中枢”,天然具备连接能力,因此也被认为是承载AI的潜在基础。但问题在于,传统集成平台的设计初衷是“数据交换”,而不是“智能协同”,通常缺乏对语义层的建模能力,在智能体运行与编排等方面的能力也相对有限,更无法管理AI推理过程与上下文。在这种架构下,即便接入AI,也只是“外挂能力”,而不是系统内生能力。

这三类路径分别解决了“理解”、“数据”和“连接”的问题,但都无法单独支撑智能体在真实医疗业务中的闭环运行。

Odin引擎AI智能版:“三位一体”解决方案,让智能体真正“活”在医疗系统中

针对上述问题,Odin 引擎 AI 智能版给出了一个极具前瞻性的回答。它基于”AI内生(AI-native)“架构,通过“三位一体”的能力体系,为医院打造新一代的数智底座:

● AI智能体应用开发平台:依托医疗AI流程引擎、MCP服务中台与医院级RAG知识库构建能力,将分散的业务知识以标准化、可理解的方式沉淀下来,为智能体提供可信的知识底座。

● 医疗集成服务平台:基于在大量医疗机构中验证的一体化集群架构,结合智能监控预警、vibe coding(氛围开发)与零停机全托管升级等能力,使集成平台从“数据通道”升级为“智能运行环境”,在保证高可靠的同时,显著降低开发与运维成本。

● 企业级API微服务平台:基于全量Open API标准与API-First开发体系,配合企业级安全防护能力,将数据与服务能力统一抽象与管理,使接口构建更加规范、调用更加高效,支撑智能体能力的复用、编排与持续扩展。

在这样的“虾塘”中,每一只智能体不再只是“会说话的龙虾”,而是能够真正参与业务、驱动系统、协同进化的生产力单元。

结语:“养龙虾”前,一定先选好“虾塘”

OpenClaw(龙虾)的走红,让智能体一夜之间变得“触手可及”。但在医疗行业,如果缺乏安全边界的数据环境、语义约束的业务逻辑以及稳定支撑的系统底座,再聪明的智能体,也只能停留在演示阶段。与其只关注“养虾”,不如更重视“虾塘”。

在CHIMA 2026期间,很多观察文章和讨论都提到:医疗AI已经过了比拼模型能力的阶段,现在真正考验的是系统的承载力。智能体的上限固然令人遐想,但其能否真正落地并实现智能协同,取决于底座所能托住的下限。

(本文由ODIN公司供稿)

首 页

首 页